Déterminer les causes des catastrophes : les plaques de Reason

Les « plaques de Reason » font référence à un modèle conceptuel développé par le psychologue britannique James Reason, spécialisé dans la sécurité et la gestion des risques. Ce modèle est souvent utilisé pour analyser les erreurs humaines et les défaillances organisationnelles dans divers domaines, y compris la sécurité industrielle, le domaine médical, l’aviation et bien d’autres.

James Reason n’est pas l’inventeur du concept de « plaques » en soi, mais il a été un pionnier dans l’application de ce concept à la compréhension des erreurs humaines. Dans les années 1990, Reason a développé la notion de « plaques » pour représenter les défenses ou barrières qui peuvent être mises en place pour prévenir les erreurs et les accidents dans un système complexe. Il a introduit ce modèle pour expliquer pourquoi certaines erreurs humaines ne conduisent pas nécessairement à des accidents, car plusieurs barrières de défense (ou plaques) sont en place pour les arrêter avant qu’elles n’aient des conséquences graves.

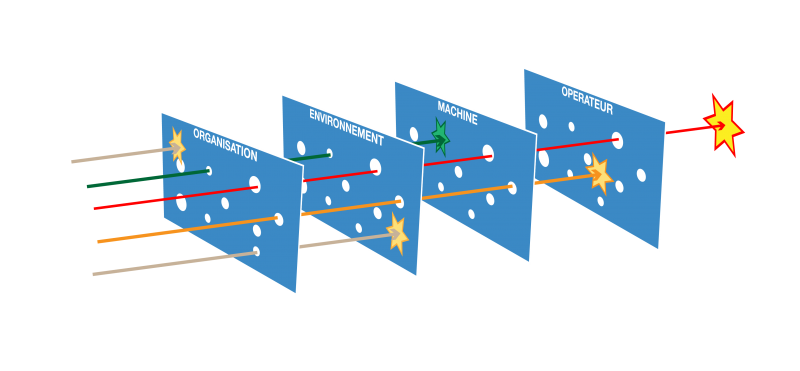

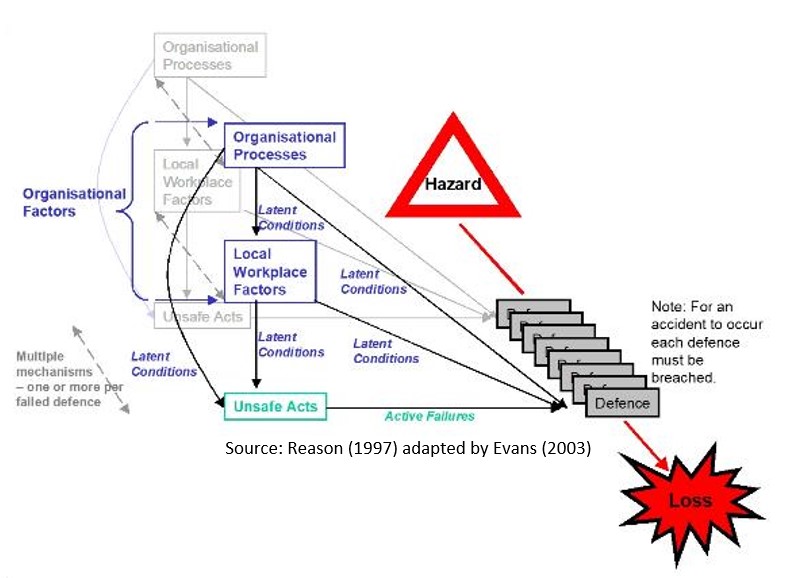

Chaque plaque correspond à un thème particulier qui contribue à la sécurité globale : formation, procédures, matériel, environnement humain, fatigue, météo, etc. Lorsqu’un accident se produit, cela signifie que plusieurs de ces plaques ont été contournées ou transpercées, permettant ainsi à l’erreur de franchir ces défenses, entraînant un accident ou un incident grave. L’analogie habituelle est de voir chaque plaque comme une tranche d’un gros gruyère comportant des trous, et s’il est possible de trouver un chemin à travers les trous qui traverse tout le gruyère, c’est l’accident.

Voir aussi l’article « Crash du F-35B de la RAF : qui est coupable ? » qui donne une application concrète de ces principes sur un exemple récent.

Les principes clés

James Reason se penche sur la sécurité dans des systèmes complexes, en partant d’un noyau vulnérable représentant l’intégrité du système. Autour de ce noyau existent des plaques de défense, des couches de protection qui agissent comme des barrières pour prévenir et contenir les erreurs.

La première plaque est constituée des systèmes techniques, conçus pour fonctionner automatiquement et surveiller le système. Cependant, ces systèmes peuvent présenter des défaillances.

La deuxième plaque comprend les opérateurs humains, formés pour intervenir et corriger les erreurs. Néanmoins, ils peuvent être sujets à des malentendus, de la fatigue, ou une surcharge d’informations, affaiblissant ainsi cette couche de défense.

La troisième plaque englobe les procédures et les protocoles. Ces règles sont conçues pour guider les actions des opérateurs en situation d’urgence. Cependant, si elles sont ambiguës, obsolètes ou inappropriées, cette plaque devient moins efficace.

Lorsque des erreurs surviennent, elles peuvent parfois traverser ces défenses successives, atteignant finalement le noyau vulnérable du système. Selon l’ampleur de l’erreur et de sa propagation, les conséquences vont d’une simple perturbation à un accident majeur.

L’enseignement principal des « plaques de Reason » est que dans des systèmes complexes, chaque plaque de défense est cruciale. Bien que les erreurs puissent se produire, des défenses solides, bien conçues et entretenues sont essentielles pour minimiser les risques et éviter des conséquences graves. Cette approche souligne l’importance d’une sécurité proactive et d’une gestion des risques constante pour prévenir les incidents et assurer la sûreté des systèmes complexes.

Un exemple d’application du concept : l’accident nucléaire de Three Mile Island en 1979

Dans cet accident, chaque maillon d’une chaîne de sécurité a été mis à l’épreuve.

Dans le cœur du réacteur nucléaire de Three Mile Island, se trouvait le noyau vulnérable représentant l’intégrité et la sécurité du réacteur. Autour de ce noyau, avaient été élaborées des plaques de défense conçues pour prévenir les erreurs.

La première plaque était l’équipement de contrôle automatique, censé surveiller et réguler le réacteur. Mais un jour, une sonde de niveau d’eau a défailli, provoquant la première fissure dans la plaque de défense.

La deuxième plaque était constituée des opérateurs humains, formés pour superviser et intervenir manuellement en cas d’urgence. Mais la confusion s’est installée lorsque des alarmes se sont mises à sonner et que les indicateurs ont montré des signes contradictoires. Les opérateurs ont lutté pour interpréter correctement la situation.

La troisième plaque consistait en des procédures opérationnelles, des guides pour les actions des opérateurs en cas d’urgence. Mais ces procédures n’étaient pas suffisamment claires et adaptées à la complexité de la situation.

Alors que les défaillances des plaques s’accumulaient, les opérateurs ont fait des choix basés sur des informations partielles et parfois contradictoires. Le réacteur a été poussé au bord du gouffre.

Finalement, le noyau vulnérable a cédé. Une fusion partielle du cœur du réacteur a eu lieu, libérant des substances radioactives dans l’environnement.

Cette histoire nous rappelle que chaque élément de sécurité dans un système complexe est crucial. Les erreurs peuvent survenir, mais des défenses fortes et fiables, si elles sont bien entretenues et améliorées, peuvent prévenir des conséquences catastrophiques. C’est ainsi que l’histoire de Three Mile Island souligne l’importance d’une sécurité robuste et d’une vigilance constante pour éviter les désastres.

Conclusion

En résumé, le modèle des plaques de Reason met en lumière l’importance de multiples défenses et barrières dans un système pour éviter les erreurs humaines et leurs conséquences néfastes. Il fournit une solide bagage intellectuel pour éviter d’accuser en premier lieu le dernier opérateur qui aura été acteur du système. Il souligne également l’importance de concevoir des systèmes avec des mécanismes de défense solides et diversifiés pour garantir la sécurité et minimiser les risques d’accidents.

Voir aussi l’article « Crash du F-35B de la RAF : qui est coupable ? » qui donne une application concrète de ces principes sur un exemple récent.

Merci encore de faire partie de nos lecteurs et à très bientôt !

Cet article vous a plu ? Laissez un commentaire ci-dessous, il sera précieux pour les autres lecteurs.

Avant de quitter, proposez-le à vos connaissances, par mail, whatsapp ou twitter (les petites icônes sont là pour ça) !