Pourquoi donc remplacer les êtres humains par des machines ? (2/2)

Cet article est le quatrième d’une série sur le thème de l’opposition entre intelligence naturelle et intelligence artificielle. Le premier aborde la nécessité d’extraire toute l’intelligence naturelle d’un groupe avant de lui imposer des outils numériques par principe, le second donne des pistes méthodologiques en ce sens, le troisième introduit le domaine de l’automatisation et de la suppléance de l’être humain, et celui-ci définit à grands traits les domaines réservés de l’homme et de la machine.

Ces articles ont pour objectif de poser des repères et des axes de réflexion, pour un domaine plus souvent abordé sous un angle sensationnel et fantasmagorique que pratique et méthodique.

« Je ne suis qu’un homme malgré tout » (Rag’n’Bone Man)

Au siècle dernier la machine a remplacé l’homme (et la bête) dans les travaux de force. Aujourd’hui elle le remplace dans les calculs compliqués et comprenant beaucoup de données (une des premières fonctions des ordinateurs), ou des interactions complexes (calculs d’optimisation et satisfaction avec un nombre de variables et de données gigantesques, en gros ce que l’on colle derrière le Big Data et les interconnections réseaux).

Nous avons vu dans un précédent article (voir ici) que le numérique s’était donc inséré dans notre environnement comme tous les autres outils : par son utilité (quoi de plus logique qu’un outil utile). Pour déterminer comment les outils numériques pourraient dépasser l’Homme, examinons donc ses caractéristiques : les bonnes et les mauvaises.

Tout comme il est possible de définir les caractéristiques d’une machine, nous pouvons brosser à grands traits les défauts et qualités de l’être humain.

Les éléments qui suivent représentent une synthèse de plusieurs cours et études de sciences cognitives et de facteurs humains principalement. Ce dernier domaine étudie en effet les limites de l’être humain, notamment dans le but de prévenir et éviter les accidents professionnels ou dans les interactions homme-machine.

Là où nous ne sommes pas très bon

1- L’être humain est plus séquentiel que multitâche : difficile d’effectuer simultanément plusieurs tâches complexes. Certes cette capacité varie d’un individu à l’autre, mais globalement nous allons effectuer beaucoup mieux les tâches les unes après les autres qu’en même temps (je vous renvoie d’ailleurs à la problématique de l’interruption de tâche évoquée dans cet article (loi de Carlson) et ici une méthode pour la traiter). Oui tout le monde arrive à mâcher un chewing-gum en marchant, sans l’avaler ni trébucher. Cependant, mâcher est dans ce cas une tâche réflexe, tout comme conduire une voiture alors qu’on écoute la radio, ou entretenir une conversation avec des « Ah oui » ou des « hum hum » quand on fait autre chose. Mais par exemple la marche n’a pas toujours été un acte réflexe. Essayez d’attirer l’attention d’un jeune enfant concentré à faire ses premiers pas, il a de grandes chances de tomber les fesses sur le sol s’il doit tourner la tête pour vous regarder. La marche reste encore pour lui un acte réfléchi et non automatique.

2- Quand il n’est pas alimenté en information, l’être humain s’alimente comme il peut, il se met à penser (voire rêver). Est-il bien nécessaire d’illustrer cette caractéristique ? Cas bien connu des salles de supervision ou des postes de garde : mieux vaut laisser une télé allumé qui, pourquoi pas, va s’interrompre sur une alarme, que de laisser un individu inactif regarder quelque chose qui n’évolue presque pas. Après avoir rêvassé, il risque de fermer les yeux et rêver tout simplement. Demandez à quelqu’un de surveiller un panneau immobile : il sera rapidement distrait par autre chose.

3- Nous sommes globalement incapables d’apprécier les probabilités : les casinos et les loteries en sont le meilleur exemple. Vous avez par exemple environ 200 fois plus de chances de finir votre vie touché par la foudre que de remporter le tirage du loto : combien de personnes connaissez-vous qui ont été touchées par la foudre ? Et vous jouez toujours au loto ? Ce qui veut dire aussi que nous avons une fâcheuse tendance à minimiser les risques. Nous nous basons sur l’expérience personnelle qui n’est généralement pas pertinente. De façon plus précise, les statistiques affirment par exemple que pour estimer que quelque chose se passe moins souvent qu’une fois par heure, il faut observer le phénomène durant … 2,3 heures, et pas une seule heure. Ce n’est pas très intuitif, ce qui explique de fait une sous-estimation régulière de l’occurence des défauts ou problèmes.

4- Nous possédons une image biaisée de notre environnement. Ceci est la contrepartie de notre capacité d’analyse des situations avec peu d’éléments (voir plus loin). Nous utilisons un certain nombre de modèles mentaux pour représenter le monde qui nous entoure : modèles géographiques, modèles de fonctionnement des objets, modèles d’analyse des comportements humains, entre autres. Tous les raccourcis mentaux que nous utilisons quotidiennement sont autant de biais qui peuvent nous tromper. De nombreux travaux sont disponibles sur le sujet (voir tout simplement la page Wikipedia sur le sujet https://fr.wikipedia.org/wiki/Biais_cognitif). Ces biais entrainent ce qu’il est coutume d’appeler une erreur de représentation, bien connue dans le monde des enquêtes et accidents. Elle crée une mauvaise appréciation de la réalité, pouvant causer des accidents. C’est par exemple le cas du conducteur qui ne comprend pas que la voiture le précédant devant freine car ses feux stops sont grillés, et s’y encastre avec surprise. Mauvaise représentation de la situation jusqu’à ce que la réalité de la physique se rappelle à lui.

Là où nous sommes plutôt bon

1- Nous sommes capables de raisonner en logique floue. En gros, entre le 0 et le 1, nous pouvons extrapoler toute une gamme de « à peu près » qui nous permettent d’évaluer une situation même lorsque les informations ne sont pas tranchées. En gros, la différence entre une logique binaire et une logique floue pourrait s’illustrer de la façon suivante pour savoir si quelqu’un est bon dans une matière : dans le premier cas, on estime que la personne est compétente ou non (0 ou 1), dans le deuxième on considère qu’elle a obtenu 16/20 à son test, donc elle est compétente mais pas totalement. Ce n’est donc pas tout blanc ou tout noir.

La discipline bénéficie néanmoins d’extrapolations théoriques qui permettent certains développements mathématiques, mais ce type de raisonnement n’est pas naturel pour un ordinateur. En revanche, nous, humains, prenons en permanence des décisions basées sur des paramètres que nous évaluons comme à peu près bons ou pas tout à fait, que l’on combine aisément avec des critères qualitatifs (voir plus loin). Par exemple (vécu), lorsque j’ai passé mon brevet de pilote privé, j’ai débuté mon test pratique par deux erreurs grossières : je me suis engagé sur la piste de moi-même en m’annonçant au lieu d’attendre que le contrôleur aérien me donne l’autorisation (car j’étais habitué à évoluer sur des terrains non contrôlés pour lesquels la procédure était ainsi), et j’ai ensuite décollé en oubliant d’enclencher les volets (ce qui ne m’a pas empêché de décoller, mais ce n’est pas vraiment recommandé). Si j’avais passé le test avec un robot qui se bornait à vérifier point par point toutes mes actions, je ne pense pas que j’aurais réussi mon test. En revanche, l’instructeur (humain) a estimé que l’ensemble du vol s’était malgré tout bien passé, que j’avais les bons réflexes, et que je méritais de réussir (ce qui m’est finalement arrivé). La vie n’est pas qu’une suite de 0 ou de 1.

Ceci dit, certains êtres humains peuvent aussi se comporter comme des robots. Mais eux peuvent se le permettre alors que les robots ne sont pas encore mûrs pour se comporter comme des êtres humains (et ne le seront d’ailleurs peut-être jamais).

2- Nous sommes capables dès le plus jeune âge d’une grande capacité de reconnaissance de forme. Montrez une fois un chat à un enfant de 2 ans et il sera capable de reconnaître tous les chats qu’il croisera : les petits, les gros, les minces, les roux, les fripés, les tigrés, les plats, etc. La machine est encore loin d’une telle performance, ce qui est d’ailleurs un enjeu pour la conduite autonome de véhicules. Je vous recommande ces articles sur le sujet (https://www.lemonde.fr/sciences/article/2019/02/25/les-bugs-de-l-intelligence-artificielle_5428168_1650684.html) : il explique que derrière des capacités a priori incroyables en matière de reconnaissance d’image acquises grâce à des algorithmes de deep learning, il suffit de changer très légèrement l’image d’un chien blanc pour qu’il soit reconnu comme une autruche, ou de modifier la position d’un éléphant dans une image pour qu’il devienne transparent ou soit identifié comme un chaise. Plus dramatique, le logiciel de pilotage d’un voiture autonome Uber a spontanément ignoré une piétonne qui traversait la route en 2018, la heurtant mortellement (voir https://www.futura-sciences.com/tech/actualites/voiture-voiture-autonome-uber-logiciel-mal-regle-origine-accident-mortel-70587/).

Le problème de ce type d’apprentissage est qu’il est totalement opaque et qu’il est très difficile d’accéder à son fonctionnement interne. En conséquence, il sera d’autant plus difficile de prouver la fiabilité de tels systèmes, et probablement aussi de les faire accepter au grand public si la sécurité est en jeu.

3- Nous sommes capables de prendre des décisions sur des critères qualitatifs et pas seulement quantitatifs. Nous sommes capables de déterminer spontanément si une personne est plus belle qu’une autre, plus respectueuse, plus déterminée, plus prudente par exemple, sans forcément s’appuyer sur des paramètres quantitatifs. L’ordinateur sera un outil formidable pour appréhender ce type de critère qualitatif à partir d’une multitude de paramètres quantitatifs, mais il aura du mal à remplacer l’être humain pour juger d’un critère qualitatif directement à partir d’une définition sommaire. En effet, un paramètre qualitatif comme la solidarité, l’esprit d’initiative, le courage, la beauté est très dépendant du groupe humain de référence et des circonstances. De plus il évolue dans le temps. Nous réévaluons en permanence ce type de paramètre, difficile pour l’instant d’en demander autant à une machine.

Au bilan : Homme ou machine ?

De ce qui vient d’être évoqué, il est possible de tirer quelques conclusions sur les domaines réservés de l’homme et de la machine.

Winner : machine

Il est globalement admis que les domaines suivants sont automatisables et voir même à réserver à la machine (nous retrouvons notamment les 4D évoqué précédemment, voir ici) :

- ce qui est dangereux pour l’Homme (travail ou manipulation délicate),

- ce qui demande une habileté exceptionnelle (travaux de grande précision, enchaînements d’opérations complexes),

- quand une seule erreur provoque une catastrophe : il est dans ce cas préférable d’assister l’opérateur par un outil automatique. Rappelons que le taux d’erreur humain est au mieux de 1/1000, c’est à dire une boulette toutes les mille actions. On cherchera aussi à réaliser une redondance dissemblable : superposition d’indicateurs quantitatifs et qualitatifs pour observer un même phénomène.

- ce qui est fastidieux (surveiller un paramètre qui varie peu ou éviter un seuil maximum, analyser un grand nombre de données).

Dans cette dernière catégorie se placent ainsi beaucoup de métiers « experts » dont la caractéristique principale est de maîtriser un grand nombre de règles, de principes ou de connaissances. En effet, de nombreux domaines sont déjà ou se trouveront rapidement en compétition avec des algorithmes : diagnostics médicaux, décisions de justice, exploitation de publications de recherche scientifique, etc.

Ces nouveaux secteurs d’activité s’ajoutent à ceux s’articulant autour de capacités « réseau », déjà bien pénétrés par les algorithmes. Il s’agit entre autres d’associer du mieux possible des personnes avec des objets (Amazon, Google, etc.) ou des personnes entre elles (Facebook, Linkedin, Meetic, Tinder, etc.) avec des algorithmes qui se perfectionnent au fil du temps (pour optimiser les associations en question, et le chiffre d’affaire…).

Dans tous ces domaines la machine devient un outil inestimable, mais elle ne remplacera jamais totalement l’être humain qui restera juge des résultats et des performances. De plus, on constate qu’il s’agit en général de systèmes « fermés », comportant un périmètre de solutions ou d’informations bornés.

Winner : Human

En revanche, l’être humain aura du mal à perdre l’avantage dans les cas suivant :

- raisonnement en logique floue : sans tomber dans des développements scientifiques qui dépassent le cadre de cet article, il est difficile de programmer une machine pour décider sur des critères plus ou moins valides. Les réseaux de neurones et l’apprentissage profond (deep learning) sont des outils qui laissent une grande latitude pour construire des algorithmes élaborées, comme AlphaGo qui devint champion mondial de go en quelques années. Mais il faut noter que l’algorithme évolue toujours dans un système « fermé » limité par les règles d’un jeu. Le monde réel est sensiblement plus vaste.

- reconnaissance de forme : comme discuté plus haut il sera difficile d’envisager un système autonome conduire au milieu d’une mégapole surpeuplée, lorsque les meilleurs algorithmes d’apprentissage transforment un éléphant en chaise quand il change de place sur une image. L’opacité des algorithmes d’apprentissage militent de plus pour garder un contrôle humain minimal dans les systèmes les plus perfectionnés.

- décisions qualitatives : il est par exemple difficile d’imaginer un robot remplacer un DRH ou modéliser la complexité d’une relation humaine dans les secteurs d’activité qui comportent une dimension sociale importante.

Dans ces domaines, il peut toujours être intéressant d’utiliser un système pour assister au maximum le processus de décision de l’opérateur, soulager sa charge cognitive et ne lui laisser que l’activité décisionnelle à forte plus-value humaine.

Dans le domaine militaire, ces questions sont abordées dans l’article que je recommande : « IA-t-il un pilote dans l’avion », DSI, Hors-série 66, Juin-juillet 2019. La conclusion de l’article est très proche de la nôtre : l’IA s’impose comme un complément de plus en plus inestimable pour l’opérateur humain, mais elle n’est pas encore prête pour le remplacer totalement.

Conclusion

Est-ce que l’homme va céder la place dans ces domaines un jour ? Beaucoup de gens pensent que c’est inéluctable et certains chercheurs se proposent même de déterminer un horizon de temps (très variable) avant cette échéance (voir https://www.technologyreview.com/s/607970/experts-predict-when-artificial-intelligence-will-exceed-human-performance/). Ceci dit, ce type de prévision n’est pas nouvelle et existe depuis les années 50 sans que nous soyons submergés par les humanoïdes. De plus, rien ne prouve que ce soit vraiment un jour possible, sans parler des critères de validité que devront satisfaire les algorithmes avant d’être lâchés dans la nature, surtout quand se posent des questions de sécurité.

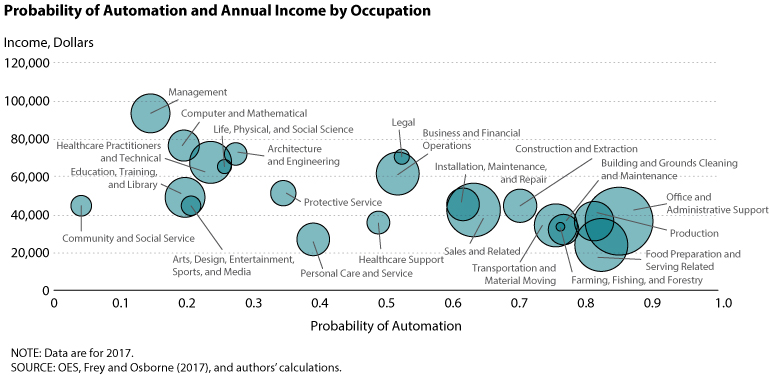

Des chercheurs se sont aussi penchés sur les emplois les plus « informatisables » en étudiant les tâches mises en oeuvre dans les processus professionnels : tâches de perception et manipulation, tâches créatives et de réflexion, and tâche d’interaction sociale. Il semblerait que 47% des emplois (américains) pourraient être touchés dans les 20 prochaines années (voir cet article : https://www.economist.com/graphic-detail/2018/04/24/a-study-finds-nearly-half-of-jobs-are-vulnerable-to-automation) avec une plus forte exposition des emplois les moins bien rémunérés (voir notamment ici : https://research.stlouisfed.org/publications/economic-synopses/2018/11/19/the-impact-of-automation-on-inequality).

Cependant, la crainte de voir l’être humain évincé du jeu par les machines semble un peu prématurée. Faire confiance à un algorithme ou à une machine n’a d’autre sens que de faire confiance à son concepteur et ceux qui ont certifié son bon fonctionnement, de la même façon que l’acheteur d’une voiture fait confiance au constructeur automobile. La psychose de la machine qui prend le pouvoir n’a pas vraiment de sens : il est difficile d’imaginer des dirigeants, qui n’ont déjà qu’une confiance limitée entre eux, déléguer une partie de leur autonomie à des programmes informatiques.

De plus, comme évoqué, certains champs décisionnels, comme l’évaluation qualitative au sens large (incluant la reconnaissance de forme), restent encore un domaine réservé pour l’homo sapiens.

Néanmoins, la multiplication et l’interconnections des données ainsi que l’utilisation d’algorithmes de plus en plus efficaces laissent entrevoir l’arrivée d’une grande panoplie d’outils performants à notre service, en complément de nos propres capacités cognitives. Et il est probable que certains métiers disparaissent et de nouveaux se créent, comme il en a toujours été…

J’espère que cet article vous aura plu. N’hésitez pas à commenter et à partager avec vos connaissances. Envoyez leur un lien vers cet article ou faites-leur passer l’email qui vous a orienté ici.

Merci encore de faire partie de nos lecteurs et à très bientôt !

Pour vous abonner si ce n’est pas déjà fait, vous pouvez cliquez ici.